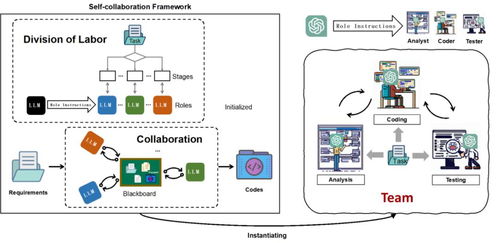

北京大学相关研究团队在人工智能领域取得突破性进展——成功构建了一个由ChatGPT驱动的AI自主软件开发系统,该系统能够独立完成从需求分析到代码生成的全流程开发任务,无需人类工程师的直接干预。这一技术探索不仅引发了学界与业界的广泛关注,更掀起了关于未来软件开发模式、人机协作关系乃至技术伦理的深层讨论。

技术实现:从辅助工具到自主主体

传统意义上,ChatGPT等大语言模型多被视为程序员的“智能助手”,用于代码补全、错误调试或文档生成等辅助性工作。北大团队的研究将这一角色推向了新的高度。通过精细的提示工程、模块化任务分解以及多轮迭代优化机制,研究团队构建的AI系统能够:

- 理解自然语言需求:系统接收用自然语言描述的功能需求,通过大模型进行语义解析与逻辑推理,将其转化为结构化的开发任务。

- 自主进行系统设计:AI能够根据需求自动选择合适的技术栈、设计软件架构、定义模块接口,并生成相应的设计文档。

- 生成与优化代码:系统依据设计,分模块生成可运行代码,并通过内置的测试用例进行自我验证与调试,循环迭代直至代码符合功能与质量要求。

- 集成与部署:在完成各模块开发后,AI可自主进行代码整合,并生成部署脚本,理论上可实现从开发到上线的闭环。

这一过程模拟了人类开发团队的分工协作,但完全由AI自主决策与执行,标志着AI从“工具”向“开发主体”的潜在转变。

潜力与优势:效率革命与能力延展

该技术的潜在优势显而易见:

- 极致效率与成本控制:AI可以不间断工作,极大压缩开发周期,并降低人力成本。对于重复性、模式化的开发任务,其优势尤为突出。

- 降低技术门槛:非专业人士通过自然语言即可描述需求,有望催生“全民开发”的新模式,加速行业应用创新。

- 知识集大成与一致性:AI模型集成了海量的开源代码与最佳实践知识,能够保证代码风格与质量的一致,避免人为疏忽。

- 处理复杂系统:对于超大规模、模块繁多的系统,AI可能更擅长管理其间的复杂依赖与接口一致性。

挑战与隐忧:技术瓶颈与伦理悬崖

通往完全自主的AI软件开发之路并非坦途,北大团队的研究也揭示了诸多待解的难题:

- 需求理解的模糊性与创造性局限:AI对模糊、矛盾或隐含需求的解读仍可能偏离人类本意。在需要突破性创新和深度业务理解的场景中,其能力尚存疑问。

- 代码质量与安全的根本保证:如何确保AI生成的代码在极端情况下依然安全、可靠?当前技术仍难以根除漏洞与后门风险,且责任归属难以界定。

- “黑箱”决策与可控性:AI的设计与编码决策过程不透明,一旦出现偏差,人类难以介入和纠正,可能导致系统性风险。

- 对就业生态与社会结构的冲击:若技术成熟,将对软件开发及相关行业就业产生深远影响,如何实现人机协同而非替代,是社会必须前瞻性思考的课题。

- 知识产权与伦理规范:AI生成的代码版权归属、训练数据使用的合规性以及防止其被用于开发恶意软件等问题,均需法律与伦理框架的同步建立。

未来展望:人机共生,而非取代

北大团队的这项探索,其意义或许不在于宣告“程序员失业”,而是勾勒出未来软件工程的新范式:人类负责顶层战略、创新构思、伦理审查与价值判断;AI则作为高效、精准的执行引擎,处理具体的实现逻辑。未来的顶尖开发者,可能是最擅长与AI沟通、设定约束与目标、并对其进行监督与优化的人。

技术的进步总是伴随着机遇与挑战。北大用ChatGPT打造自主开发团队的尝试,是一次大胆的前沿探索,它像一面镜子,既映照出人工智能令人惊叹的潜能,也迫使我们去审视那些关于控制、责任与人类价值的根本性问题。在AI自主性日益增强的时代,如何为其注入人类的智慧与善意,引导技术向善,将是比技术本身更为重要的持久命题。